안녕하세요!

오늘은 의료 인공지능 분야의 핵심 과제인 "어떻게 하면 신경망을 더 깊게 쌓으면서도 정보 손실 없이 효율적으로 학습시킬 수 있을까?"에 대한 해답을 제시하는 DenseNet 논문 리뷰와, 이를 실제 폐암 진단 데이터에 적용한 실험 결과를 상세히 정리해 드립니다.

DenseNet: Densely Connected Convolutional Networks

1. 연구 배경 및 문제 의식

심층 신경망(Deep Networks)이 발전함에 따라 기울기 소실(Vanishing Gradient) 문제가 큰 장벽이 되었습니다. ResNet은 '지름길(Shortcut)'을 통해 이 문제를 해결하려 했으나, DenseNet의 저자들은 "모든 레이어 간의 정보를 직접 연결하면 어떨까?"라는 더 급진적인 아이디어를 제안합니다.

2. 핵심 방법론: 밀집 연결(Dense Connectivity)

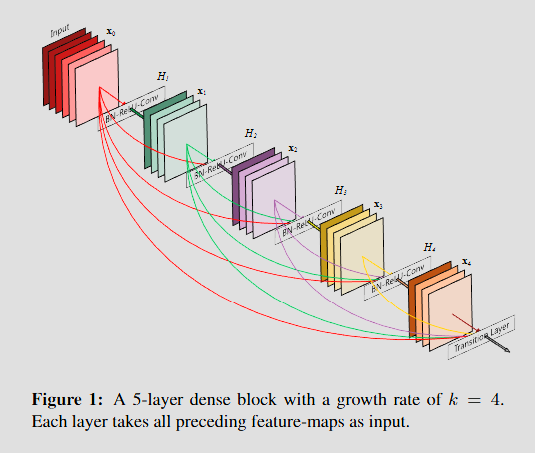

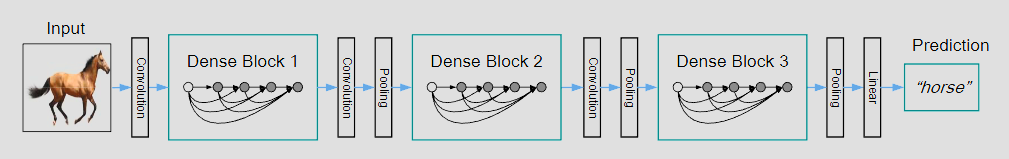

DenseNet의 핵심은 각 레이어 $H_{\ell}(\cdot)$가 이전의 모든 레이어에서 생성된 피처맵을 입력으로 받는 방식입니다.

A. 연결 공식

- ResNet (덧셈): $x_{\ell} = H_{\ell}(x_{\ell-1}) + x_{\ell-1}$ (정보가 더해지며 변형됨)

- DenseNet (연결): $x_{\ell} = H_{\ell}([x_0, x_1, \ldots, x_{\ell-1}])$ (이전 정보가 그대로 보존됨)

여기서 $[\cdot]$는 피처맵의 연결(Concatenation)을 의미합니다. 이 방식을 통해 $L$개의 레이어가 있다면 총 $L(L+1)/2$개의 직접적인 연결이 발생하여 정보 흐름이 극대화됩니다.

B. 주요 구성 요소

- 성장률(Growth Rate, $k$): 각 레이어가 생성하는 피처맵의 개수입니다. DenseNet은 이전 레이어의 정보를 재사용하므로 $k=12$와 같은 작은 값으로도 충분히 강력한 성능을 냅니다.

- 병목 레이어(Bottleneck Layer, DenseNet-B): $3 \times 3$ 연산 전 $1 \times 1$ Conv를 추가하여 연산 효율을 높입니다.

- 전이 레이어(Transition Layer, DenseNet-C): 피처맵의 크기를 줄이기 위해 블록 사이에 배치하며, 압축 계수 $\theta$를 통해 채널 수를 줄입니다.

3. 논문 실험 결과 요약

- 파라미터 효율성: 0.8M 파라미터의 DenseNet이 10.2M 파라미터의 ResNet과 대등한 성능을 보이며 90%의 자원 절감을 달성했습니다.

- ImageNet 성능: DenseNet-201(20M)은 파라미터가 2배 더 많은 ResNet-101(40M)과 유사한 정확도를 기록했습니다.

[실험] DenseNet vs ResNet 폐암 진단 성능 비교

논문의 이론적 우수성을 확인하기 위해 IQ-OTH_NCCD 폐암 CT 데이터셋을 활용하여 4가지 모델의 성능을 정밀 비교했습니다.

1. 실험 환경 및 데이터셋

- 대상: 정상(Normal), 악성(Malignant), 양성(Benign) CT 이미지

- 전처리 핵심: 인체 경계선 밖을 0(검정)으로 처리하여 정보 순도 극대화, 랜덤 회전 및 반전을 통한 데이터 증강 수행.

2. 정량적 성능 지표 분석

DenseNet 계열은 모든 변형 모델에서 정확도 100%를 달성하며 ResNet을 압도했습니다.

| 모델 | 최고 정확도 | F1-Score | 파라미터 수 | 연산량(FLOPs) | 효율성 비율 |

| ResNet-50 | 99.67% | 0.9967 | 25.6M | 4.1G | 1.00 |

| DenseNet-121 | 100.0% | 1.0000 | 8.0M | 2.8G | 3.20 |

| DenseNet-169 | 100.0% | 1.0000 | 14.3M | 3.4G | 1.79 |

| DenseNet-161 | 100.0% | 1.0000 | 28.7M | 7.7G | 0.89 |

💡 분석 결과: DenseNet-121은 ResNet-50 대비 파라미터는 31%, 연산량은 68% 수준에 불과하지만 더 완벽한 성능을 보였습니다.

3. 오분류 상세 분석 (Confusion Matrix)

의료 진단에서 0.33%의 차이는 생명과 직결됩니다.

- ResNet-50: 정상(Normal) 케이스 중 3건을 양성(Benign)으로 오분류했습니다. 이는 불필요한 추가 검사나 과잉 진단으로 이어질 수 있습니다.

- DenseNet 계열: 모든 모델이 오분류 0건을 기록했습니다. 특히 암 진단에서 가장 위험한 '악성(Malignant)을 놓치는 경우(위음성)'가 전혀 발생하지 않았습니다.

4. 설명 가능한 AI (Grad-CAM) 분석

모델이 이미지의 어디를 보고 판단했는지 시각화한 결과, 구조적 차이가 극명하게 드러났습니다.

- ResNet-50: 활성화 패턴이 넓고 확산되어 있어, 병변 외의 주변 영역까지 두루 살피는 경향이 있습니다.

- DenseNet 계열: 결절의 가장자리와 불규칙한 텍스처 등 병리학적으로 중요한 미세 영역에 매우 날카롭게 집중합니다.

- 특히 DenseNet-161(k=48)은 가장 정밀한 ROI(관심 영역) 포착 능력을 보여 방사선과 전문의의 신뢰도가 가장 높을 것으로 평가되었습니다.

5. 학습 동역학 (Learning Dynamics)

- 수렴 속도: DenseNet은 직접적인 기울기 전파 덕분에 초기 5 Epoch 이내에 ResNet보다 빠르게 안정권에 진입했습니다.

- 안정성: Validation Loss 곡선이 ResNet보다 훨씬 부드럽게 하락하며, Dense 연결 구조가 과적합 저항성에도 강점이 있음을 확인했습니다.

최종 결론 및 모델 선택 가이드

본 실험을 통해 DenseNet 아키텍처가 의료 영상 분석, 특히 미세한 패턴 식별이 중요한 CT 분석에서 ResNet보다 우월함을 입증했습니다.

- 실무 배포 최우선 (Best Overall): DenseNet-121

- 가장 적은 자원(8M 파라미터)으로 완벽한 성능을 냅니다. 모바일이나 저사양 의료 장비에 가장 적합합니다.

- 최고 정밀도 필요 (High Precision): DenseNet-161

- 연산량은 많지만, 가장 정교한 특징 추출과 시각적 설명력을 제공합니다. 대학병원급 정밀 판독 시스템에 권장합니다.

- 예비 스크리닝 (Fast Screening): ResNet-50

- 학습 및 추론 속도가 가장 빠르므로, 대량의 데이터를 빠르게 훑어보는 1차 분류용으로 적합합니다.